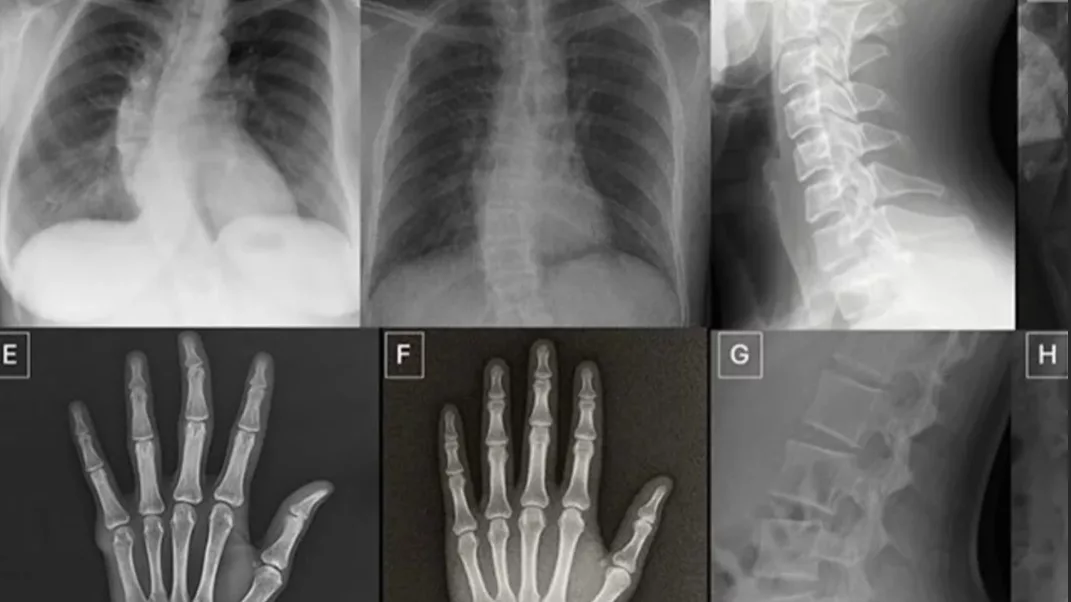

La investigación, liderada por el Dr. Mickael Tordjman y su equipo de la Icahn School of Medicine del Mount Sinai (Nueva York), evaluó la capacidad de 17 radiólogos de seis países para identificar imágenes médicas sintéticas en un conjunto de 264 radiografías. La mitad de las imágenes eran reales y la otra mitad había sido generada por modelos de IA como ChatGPT‑4o y RoentGen, un sistema especializado en crear radiografías sintéticas.

Sin advertencia previa, la mayoría falló.

Cuando los radiólogos no sabían que se les habían incluido imágenes falsas, apenas el 41 % de los profesionales identificó correctamente cuáles eran generadas por IA, una tasa apenas superior al azar.

Al informarles que en el grupo había falsificaciones, la precisión promedio mejoró, pero siguió siendo limitante: los participantes lograron un 75 % de aciertos en promedio, con rangos individuales que oscilaron entre un 58 % y 92 % en imágenes generadas por ChatGPT‑4o, y entre 62 % y 78 % en las creadas con RoentGen.

Un hallazgo significativo fue que la experiencia profesional no fue determinante para detectar las imágenes falsas: tanto radiólogos novatos como expertos con décadas de ejercicio mostraron rendimientos similares. Sin embargo, especialistas en radiología musculoesquelética se desempeñaron algo mejor, probablemente por su familiaridad con ciertos patrones anatómicos.

La IA incluso confunde a la propia IA.

El estudio también evaluó cuatro modelos de lenguaje multimodal —incluidos GPT‑4o, GPT‑5, Gemini 2.5 Pro de Google y Llama 4 Maverick de Meta— para discernir qué imágenes eran reales o falsas. Aunque estos sistemas lograron niveles razonables de precisión (57 % a 85 % en imágenes de ChatGPT y hasta 89 % en algunas pruebas), ninguno fue completamente confiable, incluida la versión utilizada para generar las imágenes sintéticas.

Riesgos legales y clínicos.

Los investigadores advierten que estas imágenes médicas sintéticas presentan vulnerabilidades reales para la práctica clínica y legal. Por ejemplo, una fractura “inventada” por IA podría ser difícil de diferenciar de una real en un juicio por mala praxis o en un reclamo de seguro. Además, existe el riesgo de que ciberdelincuentes infiltren redes hospitalarias e inserten radiografías generadas por IA en expedientes clínicos para manipular diagnósticos, lo que podría desencadenar desde tratamientos innecesarios hasta la omisión de atención crítica.

Para Tordjman, estas limitaciones no son un obstáculo menor: “las imágenes médicas falsas suelen verse demasiado perfectas —huesos excesivamente lisos, columnas vertebrales inusualmente rectas, pulmones excesivamente simétricos— y pueden pasar desapercibidas incluso para ojos expertos”, según explicó.

El estudio no solo pone de manifiesto esta vulnerabilidad, sino que también hace un llamado a la comunidad médica para desarrollar herramientas de detección, protocolos de verificación y formación especializada que permitan enfrentar este nuevo desafío en la intersección entre la práctica clínica y la inteligencia artificial.

Tu opinión enriquece este artículo: